Alan Turing, Máquinas computacionais e inteligência

Arquipélago

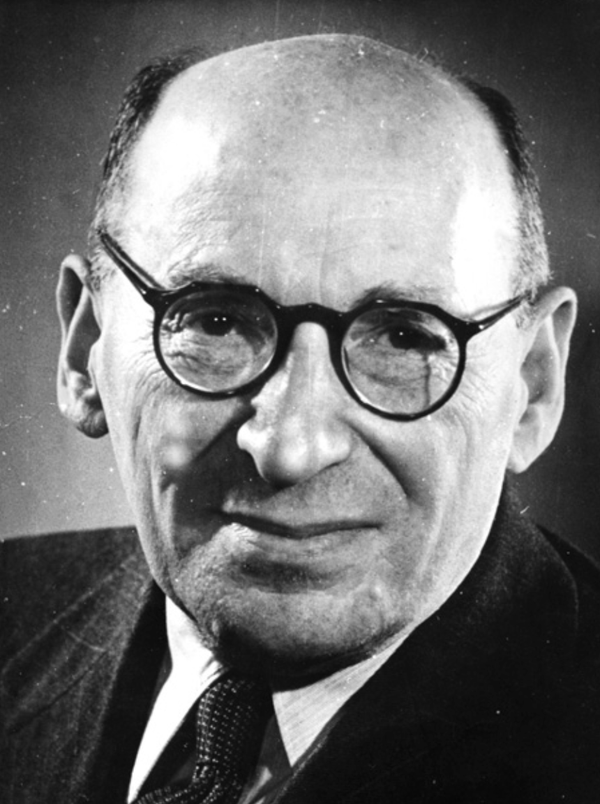

Alan M. Turing (1912-1954) foi um matemático e lógico britânico, pioneiro da ciência da computação. Contribuiu tanto para a formulação teórica da ideia de um computador quanto para a construção dos primeiros computadores eletrônicos, na década de 1940. Além disso, refletiu sobre as implicações filosóficas dessas máquinas. O artigo aqui publicado é um de seus textos mais importantes acerca desse tópico. Foi traduzido do inglês por Florencia Salaberry e revisado por Rogério Severo. O texto original encontra-se na revista Mind, vol. 49, 1950, pp. 433-460.

Máquinas computacionais e inteligência

Alan M. Turing

1. O jogo da imitação

Proponho que consideremos a questão: “Máquinas podem pensar?” Essa reflexão deveria iniciar com definições dos termos “máquinas” e “pensar”. As definições poderiam ser elaboradas de modo a refletir, na medida do possível, o uso comum das palavras, mas tal atitude é perigosa. Se os significados das palavras “máquina” e “pensar” precisarem ser encontrados por meio de um escrutínio do seu uso habitual, será difícil escapar da conclusão de que o significado e a resposta da pergunta “Máquinas podem pensar?” deveriam ser procurados numa pesquisa estatística, como uma pesquisa de opinião do Gallup. Mas isso é absurdo. Em vez de tentar uma definição desse tipo, proponho substituir essa pergunta por outra, similar e expressa em palavras menos ambíguas.

A nova formulação do problema pode ser descrita em termos de um jogo que chamamos de “jogo da imitação”. Ele é jogado por três pessoas: um homem (A), uma mulher (B), e um interrogador (C), que pode ser de qualquer dos sexos. O interrogador permanece num quarto, separado dos outros dois. O objetivo do jogo, para o interrogador, é determinar qual deles é o homem e qual, a mulher. Ele os identifica com os rótulos X e Y e, no fim do jogo, ou diz que “X é A e Y é B”, ou que “X é B e Y é A”. É permitido ao interrogador fazer perguntas a A e B, tais como:

C: X, você poderia me dizer qual o comprimento de seu cabelo?

Supondo-se agora que X seja realmente A, então A deverá responder. Para A, o objetivo do jogo é tentar induzir C a fazer uma identificação errada. Sua resposta, portanto, poderia ser:

“Meu cabelo é cortado em camadas, e os fios mais longos têm cerca de 23 centímetros”.

Para que os tons de voz não ajudem o interrogador, as respostas devem ser escritas ou, ainda melhor, datilografadas. As condições ideais deveriam incluir um teletipo que comunique os dois quartos. Alternativamente, a pergunta e as respostas podem ser repetidas por um intermediário. Para B, o objetivo do jogo é ajudar o interrogador. Sua melhor estratégia provavelmente seja dar respostas verdadeiras. Ela pode acrescentar frases como: “Eu sou a mulher, não lhe dê ouvidos”. Mas isso seria inútil, porque o homem pode dar respostas semelhantes.

Agora fazemos a pergunta “o que aconteceria se uma máquina ocupasse o lugar de A nesse jogo?” Se o jogo fosse jogado dessa forma, o interrogador decidiria erroneamente, com a mesma frequência que o faz quando os dois outros jogadores são um homem e uma mulher? Essas perguntas substituem nossa pergunta original “Máquinas podem pensar?”

2. Crítica do novo problema

Assim como podemos perguntar “qual a resposta para essa nova pergunta?”, poderíamos perguntar “vale a pena investigar essa nova pergunta?” Nós a investigaremos prontamente, evitando assim uma regressão infinita.

O novo problema tem a vantagem de traçar uma linha bastante nítida entre as capacidades físicas e intelectuais de uma pessoa. Nenhum engenheiro ou químico alega ser capaz de produzir um material que seja indistinguível da pele humana. É possível que algum dia isso possa ser feito, mas, mesmo supondo que tal invenção estivesse disponível, deveríamos perceber que há pouca vantagem em tentar tornar uma “máquina pensante” mais humana revestindo-a com essa pele artificial. A forma em que colocamos o problema reflete esse fato por impedir o interrogador de ver ou tocar os outros competidores, ou ouvir as suas vozes. Algumas outras vantagens do critério proposto podem ser exemplificadas por uma amostra de perguntas e respostas, tais como:

P: Por favor, escreva-me um soneto cujo tema seja a Forth Bridge[^1].

R: Poupe-me disso. Nunca consegui escrever poesia.

P: Some 34.957 e 70.764.

R: (Pause mais ou menos 30 segundos e depois responda) 105.721.

P: Você joga xadrez?

R: Sim.

P: Eu tenho R em R1, e nenhuma outra peça. Você tem somente R em R6 e T em T1. É a sua vez. Qual o seu lance?

R: (Depois de uma pausa de 15 segundos) T-T8, xeque-mate.

O método de pergunta e resposta parece ser adequado para uso em quase todos os campos da atividade humana que desejarmos abarcar. Não queremos punir a máquina por sua incapacidade de brilhar em concursos de beleza, nem punir um homem por perder uma corrida contra um avião. As condições de nosso jogo tornam descabidas essas incapacidades. As “testemunhas” podem se vangloriar, se o acharem conveniente, do seu fascínio, força ou heroísmo, mas o interrogador não pode pedir demonstrações práticas.

O jogo talvez possa ser criticado sob o pretexto de que as desvantagens da máquina são demasiadas. Se o homem tentasse fingir ser uma máquina, certamente teria uma performance muito fraca. Ele se trairia imediatamente por sua lentidão e imprecisão em aritmética. Não seria possível que as máquinas realizassem algo que pudéssemos descrever como pensamento, ainda que muito diferente do que uma pessoa realiza? Trata-se de uma objeção muito forte. Contudo, ao menos podemos dizer que, se pudermos construir uma máquina capaz de jogar satisfatoriamente o jogo da imitação, não precisamos nos preocupar com semelhante objeção.

Poderia ser alegado que, ao jogar o “jogo da imitação”, a melhor estratégia para a máquina poderia ser não imitar o comportamento de uma pessoa. Ainda que isso seja possível, acho improvável que uma máquina o faça. De qualquer modo, aqui não há nenhuma intenção de investigar a teoria desse jogo, e vamos pressupor que a melhor estratégia é tentar oferecer respostas que seriam naturalmente dadas por um homem.

3. As máquinas envolvidas no jogo

A pergunta que fizemos na seção 1 não estará bem definida antes de especificarmos o que pretendemos dizer com a palavra “máquina”. É natural que queiramos permitir que todo tipo de técnica de engenharia seja usado em nossas máquinas. Também desejaríamos admitir a possibilidade de um engenheiro ou uma equipe de engenheiros construir uma máquina que funcione, mas cujo modo de operação não possa ser satisfatoriamente descrito por seus construtores, por terem usado um método em grande parte empírico. Finalmente, queremos excluir do grupo das máquinas todos os humanos de carne e osso. É difícil moldar as definições de modo a satisfazer essas três condições. Poderíamos, por exemplo, insistir que os membros da equipe de engenheiros fossem todos do mesmo sexo, mas isso não seria de fato satisfatório, porque provavelmente é possível criar um indivíduo completo a partir de uma única célula da pele de um homem, digamos. Realizar isso seria uma proeza da técnica biológica digna dos maiores elogios, mas não estaríamos dispostos a considerá-la como um caso de “construção de uma máquina pensante”. Isso nos leva a abandonar a exigência de que todo tipo de técnica deveria ser permitido. Ficamos mais dispostos a abandoná-la ao considerarmos que o atual interesse por “máquinas pensantes” foi despertado por um tipo particular de máquina, geralmente chamado de “computador eletrônico” ou “computador digital”. Seguindo essa sugestão, só permitimos que computadores digitais participem de nosso jogo.

À primeira vista, essa restrição parece muito drástica. Tentarei mostrar que na realidade ela não é. Mas isso exige uma breve explicação da natureza e das propriedades desses computadores.

Também poderíamos dizer que essa identificação de máquinas com computadores digitais, tanto quanto o nosso critério de “pensar”, só será insatisfatório se (ao contrário do que acredito) os computadores digitais se revelarem incapazes de um bom desempenho no jogo.

Já há um certo número de computadores digitais em funcionamento, e poderíamos perguntar: “por que não tentar o experimento imediatamente? Seria fácil satisfazer as condições do jogo. Poderíamos usar um certo número de interrogadores e compilar estatísticas para mostrar a frequência da ocorrência das identificações corretas”. A resposta breve é que não estamos perguntando se todos os computadores digitais se sairiam bem no jogo, nem se os computadores atualmente disponíveis teriam um bom desempenho, mas se existem computadores imagináveis capazes disso. Mas essa é apenas a resposta imediata. Examinaremos a questão mais tarde sob outro ângulo.

4. Computadores digitais

A ideia por trás dos computadores digitais pode ser explicada dizendo que essas máquinas são projetadas para executar quaisquer operações que poderiam ser feitas por um computador humano. Supõe-se que o computador humano siga regras fixas; ele não tem autoridade para se desviar delas em nenhum detalhe. Podemos supor que essas regras se encontrem em um livro, que é alterado sempre que esse computador recebe uma nova tarefa. Ele também possui um suprimento ilimitado de papel para fazer seus cálculos. Também poderia fazer suas multiplicações e adições em uma “máquina de escritório”, mas isso não é importante.

Se usamos a explicação acima como uma definição, corremos o risco de incorrer em uma circularidade argumentativa. Evitamos isso apresentando um esboço dos meios pelos quais se alcança o efeito desejado. De forma geral, pode-se considerar que um computador digital é composto de três partes:

(i) Armazenamento

(ii) Unidade executiva

(iii) Controle

O armazenamento é um repositório de informações e corresponde ao papel que o computador humano utiliza, seja o papel no qual ele faz seus cálculos ou aquele no qual seu livro de regras está impresso. À medida que o computador humano realiza cálculos em sua cabeça, uma parte do armazenamento corresponderá à sua memória.

A unidade executiva é a parte que executa as várias operações individuais envolvidas em um cálculo. Quais são essas operações individuais varia de máquina para máquina. Normalmente, operações bastante longas podem ser realizadas, como “multiplique 3540675445 por 7076345687”, mas em algumas máquinas apenas operações muito simples, como “escreva 0”, são possíveis.

Mencionamos que o “livro de regras” fornecido ao computador humano é substituído na máquina por uma parte do armazenamento. Assim, passa a ser denominado “tabela de instruções”. O dever do controle é garantir que essas instruções sejam obedecidas corretamente e na ordem certa. O controle é construído de forma a garantir que isso necessariamente aconteça.

As informações no armazenamento geralmente são divididas em pacotes de tamanho moderadamente pequeno. Em uma máquina, por exemplo, um pacote pode consistir em dez dígitos decimais. Atribuem-se números às partes do armazenamento em que os vários pacotes de informações são guardados, de forma sistemática. Uma instrução típica poderia dizer:

“Some o número armazenado na posição 6809 ao número na posição 4302 e coloque o resultado de volta na última posição de armazenamento”.

É óbvio que isso não ocorreria na máquina com expressões em inglês. Seria mais provavelmente codificado em um formato como 6809430217. Aqui, 17 indica qual das várias operações possíveis deve ser realizada com os dois números; nesse caso, a operação é a descrita acima: “Some os números...”. Observe que a instrução ocupa 10 dígitos e, portanto, forma um pacote de informações, o que é bastante conveniente. O controle normalmente executará as instruções na ordem em que estão armazenadas, mas ocasionalmente uma instrução como

“Agora, obedeça à instrução armazenada na posição 5606 e continue a partir daí”

poderia ser encontrada, ou ainda

“Se a posição 4505 contiver 0, obedeça à instrução armazenada em 6707; caso contrário, continue em frente”.

Instruções desse último tipo são muito importantes porque permitem que uma sequência de operações seja repetida várias vezes até que alguma condição seja atendida, obedecendo, não a novas instruções a cada repetição, mas às mesmas instruções, repetidamente. Para usar uma analogia doméstica. Suponha que Mãe queira que Tommy passe na sapataria todas as manhãs a caminho da escola para ver se seus sapatos estão prontos; ela pode lhe pedir isso todas as manhãs, repetidamente. Alternativamente, pode afixar um aviso definitivo no corredor, que ele verá ao sair para a escola, e que o instrui a passar na sapataria para buscar os sapatos; como também a destruir o aviso quando voltar, caso esteja com os sapatos.

O leitor deve aceitar como fato que computadores digitais podem ser construídos, e de fato já foram construídos, de acordo com os princípios que descrevemos, e que eles podem, na verdade, imitar as ações de um computador humano com muita precisão.

O livro de regras que descrevemos como sendo usado pelo nosso computador humano é, obviamente, uma ficção conveniente. Na verdade, os computadores humanos reais se lembram do que precisam fazer. Se alguém quiser fazer uma máquina imitar o comportamento do computador humano em alguma operação complexa, precisa perguntar a ele como isso é feito e, em seguida, traduzir a resposta para a forma de uma tabela de instruções. A construção de tabelas de instruções geralmente é descrita como “programação”. “Programar uma máquina para executar a operação A” significa inserir na máquina a tabela de instruções apropriada para que ela execute A.

Uma variante interessante da ideia de um computador digital é um “computador digital com algum elemento aleatório”. Tais computadores possuem instruções que envolvem o lançamento de um dado ou algum processo eletrônico equivalente. Uma dessas instruções poderia ser, por exemplo: “Lance o dado e coloque o número resultante no armazenamento 1000”. Às vezes, tal máquina é descrita como tendo livre arbítrio (embora eu não usaria essa expressão). Normalmente, não é possível determinar, apenas observando uma máquina, se ela possui um elemento aleatório, pois um efeito semelhante pode ser produzido por dispositivos que fazem as escolhas dependerem dos dígitos decimais de π.

A maioria dos computadores digitais atuais possui apenas um armazenamento finito. Não há dificuldade teórica na ideia de um computador com armazenamento ilimitado. É claro que apenas uma parte finita pode ser usada em um determinado momento. Da mesma forma, apenas uma quantidade finita pode ter sido construída, mas podemos imaginar que, conforme necessário, mais e mais sejam adicionadas. Essas máquinas são, do ponto de vista teórico, especialmente interessantes; serão chamadas de computadores de capacidade infinita.

A ideia de um computador digital é antiga. Charles Babbage, Professor da Cátedra Lucasiana[^2], em Cambridge, de 1828 a 1839, planejou uma máquina desse tipo, que chamou de “Máquina Analítica”, mas ela nunca foi concluída. Embora Babbage tivesse todas as ideias essenciais, sua máquina não era, naquela época, uma promessa muito atrativa. Sua velocidade de funcionamento seria definitivamente mais rápida do que a de um computador humano, mas algo como 100 vezes mais lenta do que a máquina de Manchester, que por si só já era uma das máquinas modernas mais lentas. O armazenamento seria puramente mecânico, usando rodas e cartões.

O fato de a Máquina Analítica de Babbage ser inteiramente mecânica nos ajudará a escapar de uma superstição. Muitas vezes, dá-se importância ao fato de os computadores digitais modernos serem elétricos e de o sistema nervoso também ser elétrico. Como a máquina de Babbage não era elétrica e, como todos os computadores digitais são, em certo sentido, equivalentes, vemos que esse uso da eletricidade não pode ter importância teórica. É claro que a eletricidade geralmente entra em cena quando se necessita de uma transmissão rápida de sinais, de modo que não é surpreendente encontrá-la em ambas as conexões. No sistema nervoso, os fenômenos químicos são ao menos tão importantes quanto os elétricos. Em certos computadores, o sistema de armazenamento é principalmente acústico. A característica de usar eletricidade, portanto, é vista como apenas uma semelhança muito superficial. Se quisermos encontrar tais semelhanças, devemos recorrer a analogias matemáticas de função.

5. Universalidade dos computadores digitais

Os computadores digitais considerados na seção anterior podem ser classificados entre as “máquinas de estados discretos”, que são máquinas que se movem usando saltos súbitos ou cliques, de um estado bem definido para outro. Esses estados são suficientemente distintos para que se ignore a possibilidade de confusão entre eles. Estritamente falando, não existem tais máquinas. Tudo realmente se move continuamente. Mas existem muitos tipos de máquina que podem ser considerados, com proveito, como máquinas de estados discretos. Por exemplo, ao considerar os interruptores de um sistema de iluminação, é conveniente supor que cada interruptor esteja definitivamente ligado ou desligado. Deve haver posições intermediárias, mas, para a maioria dos nossos propósitos, podemos ignorá-las. Como exemplo de uma máquina de estados discretos, podemos considerar uma roda que salta 120° a cada segundo, mas que pode ser parada por uma alavanca externa; além disso, uma lâmpada deve acender em uma das posições da roda. Esta máquina poderia ser descrita abstratamente da seguinte forma: o estado interno da máquina (que é descrito pela posição da roda) pode ser q1, q2 ou q3. Há um sinal de entrada i0 ou i1 (posição da alavanca). O estado interno, em qualquer instante, é determinado pelo último estado e o sinal de entrada, de acordo com esta tabela:

Os sinais de saída, as únicas indicações visíveis externamente do estado interno (a luz), são descritos pela tabela:

| Estado: | q1 | q2 | q3 |

| Saída: | o0 | o0 | o1 |

Esse exemplo é típico de máquinas de estados discretos. Elas podem ser descritas por tais tabelas, desde que tenham apenas um número finito de estados possíveis.

Pode parecer que, dado o estado inicial da máquina e os sinais de entrada, é sempre possível prever todos os estados futuros. Isso lembra a concepção de Laplace de que, a partir do estado completo do universo em um dado momento, descrito pelas posições e velocidades de todas as partículas, deveria ser possível prever todos os estados futuros. A previsão que estamos considerando, no entanto, está bem mais próxima da praticidade do que a considerada por Laplace. O sistema do “universo como um todo” é tal que erros bastante pequenos nas condições iniciais podem ter um efeito avassalador posteriormente. O deslocamento de um único elétron por um bilionésimo de centímetro, em um dado momento, pode fazer a diferença entre um homem ser morto por uma avalanche um ano depois ou escapar dela. É uma propriedade essencial dos sistemas mecânicos que chamamos de “máquinas de estados discretos” que esse fenômeno não ocorra. Mesmo quando consideramos máquinas físicas reais, em vez de máquinas idealizadas, um conhecimento razoavelmente preciso do estado, em um determinado momento, resulta em um conhecimento razoavelmente preciso de um estado posterior, depois de um determinado número de passos.

Como já mencionamos, os computadores digitais enquadram-se na classe das máquinas de estados discretos. Mas o número de estados que tal máquina é capaz de assumir geralmente é imenso. Por exemplo, o número para a máquina que está funcionando atualmente em Manchester é de cerca de $2^{165.000}$, ou seja, cerca de $10^{50.000}$. Compare isso com o nosso exemplo da máquina descrita acima, que tinha três estados. Não é difícil entender por que o número de estados deve ser tão imenso. O computador inclui um armazenamento correspondente ao papel usado por um computador humano. Deve ser possível escrever no armazenamento qualquer uma das combinações de símbolos que poderiam ter sido escritas no papel. Para simplificar, suponha que apenas dígitos de 0 a 9 sejam usados como símbolos. Variações na caligrafia são ignoradas. Suponha que o computador tenha permissão para usar 100 folhas de papel, cada uma contendo 50 linhas com espaço para 30 dígitos. Então, o número de estados é de $10^{100 \times 50 \times 30}$, ou seja, $10^{50.000}$. Isso corresponde aproximadamente ao número de estados de três máquinas de Manchester juntas. O logaritmo na base dois do número de estados é geralmente chamado de “capacidade de armazenamento” da máquina. Assim, a máquina de Manchester tem uma capacidade de armazenamento de cerca de 165.000, enquanto a máquina do nosso exemplo, cerca de 1,6. Se duas máquinas forem unidas, suas capacidades devem ser somadas para se obter a capacidade da máquina resultante. Isso leva à possibilidade de afirmações como “a máquina de Manchester contém 64 trilhas magnéticas, cada uma com capacidade de 2.560, oito válvulas eletrônicas com capacidade de 1.280. O armazenamento heterogêneo chega a cerca de 300, resultando em um total de 174.380”.

Dada a tabela correspondente a uma máquina de estados discretos, é possível prever o seu comportamento. Não há razão para que esse cálculo não possa ser realizado por meio de um computador digital. Contanto que pudesse ser executado com rapidez suficiente, o computador digital poderia imitar o comportamento de qualquer máquina de estados discretos. O jogo da imitação poderia então ser jogado com a máquina em questão (como se fosse B) e o computador digital imitador (como se fosse A); assim, o interrogador seria incapaz de distingui-los. É claro que o computador digital deve ter uma capacidade de armazenamento adequada, além de funcionar com velocidade suficiente. Além disso, ele deve ser programado novamente para cada nova máquina que se deseja imitar.

Descrevemos essa propriedade especial dos computadores digitais, de serem capazes de imitar qualquer máquina de estados discretos, dizendo que são máquinas universais. A existência de máquinas com essa propriedade tem a importante consequência de que, considerações de velocidade à parte, é desnecessário projetar várias novas máquinas para realizar vários processos computacionais. Todos eles podem ser feitos com um só computador digital, programado adequadamente para cada caso. Veremos que, como consequência disso, todos os computadores digitais são, em certo sentido, equivalentes.

Podemos agora considerar novamente o tópico mencionado no final da seção 3. Foi sugerido provisoriamente que a pergunta “máquinas podem pensar?” fosse substituída por “existem computadores digitais imagináveis que teriam um bom desempenho no jogo da imitação?” Se quisermos, podemos tornar isso superficialmente mais geral e perguntar “existem máquinas de estado discreto que se sairiam bem?” Mas, tendo em vista a propriedade da universalidade, vemos que qualquer uma dessas perguntas é equivalente à seguinte: “Fixemos nossa atenção em C, um computador digital específico. É verdade que, modificando-se C para obter um armazenamento adequado, aumentando apropriadamente sua velocidade de ação e lhe fornecendo um programa apropriado, ele poderia desempenhar satisfatoriamente o papel de A no jogo da imitação, sendo o papel de B desempenhado por um homem?”

6. Concepções contrárias a respeito da pergunta principal

Podemos agora considerar que o terreno foi delimitado e que estamos prontos para prosseguir com o debate de nossa questão: “Máquinas podem pensar?” e a variante dela citada no final da seção anterior. Não podemos abandonar completamente a forma original do problema, pois as opiniões divergirão quanto à adequação da substituição, e devemos, ao menos, ouvir o que pode ser dito a esse respeito.

Ficará mais simples para o leitor se eu explicar primeiro minhas próprias crenças acerca desse assunto. Considere primeiro a forma mais precisa da questão. Acredito que, daqui a cerca de cinquenta anos, será possível programar computadores, com capacidade de armazenamento de aproximadamente 109, para que executem o jogo da imitação tão bem que um interrogador mediano, após cinco minutos de questionamento, terá no máximo 70% de chance de identificar corretamente a pessoa. A pergunta original, “Máquinas podem pensar?” é, a meu ver, tão sem sentido que dispensa discussão. Contudo, acredito que, ao final do século, o uso das palavras e a opinião pública terão se alterado tanto que será possível falar de máquinas pensantes sem receio de ser contestado. Acredito ainda que ocultar essas crenças não traz nenhum benefício. A concepção popular de que os cientistas procedem inexoravelmente de um fato bem estabelecido para outro, sem jamais serem influenciados por qualquer conjectura não provada, é completamente equivocada. Contanto que fique claro quais são os fatos comprovados e quais são as conjecturas, nenhum mal poderá advir. As conjecturas são de grande importância, pois sugerem linhas de pesquisa úteis.

Passo agora a considerar opiniões contrárias à minha.

(1) A objeção teológica. Pensar é uma função da alma imortal do homem. Deus deu uma alma imortal a cada homem e mulher, mas não a nenhum outro animal ou a máquinas. Portanto, nenhum animal ou máquina pode pensar.

Não consigo aceitar nenhuma parte disso, mas tentarei responder em termos teológicos. Eu acharia o argumento mais convincente se os animais fossem classificados junto com os humanos, pois há uma diferença maior, a meu ver, entre o animado típico e o inanimado do que entre os homens e os outros animais. O caráter arbitrário da concepção ortodoxa se torna mais claro se considerarmos como ela poderia parecer a um membro de alguma outra comunidade religiosa. Como os cristãos encaram a concepção muçulmana de que as mulheres não têm alma? Mas deixemos esse ponto de lado e voltemos ao argumento principal. Parece-me que o argumento citado acima implica uma séria restrição da onipotência do Todo-Poderoso. Admite-se que há certas coisas que Ele não pode fazer, como tornar um igual a dois, mas não deveríamos acreditar que Ele tem a liberdade de conferir uma alma a um elefante se assim o desejar? Poderíamos esperar que Ele só exercesse esse poder em conjunto com uma mutação que fornecesse ao elefante um cérebro adequadamente aprimorado para atender às necessidades desse tipo. Um argumento de forma exatamente semelhante pode ser feito para o caso das máquinas. Pode parecer diferente porque é mais difícil de “engolir”. Mas isso significa apenas que achamos menos provável que Ele considerasse as circunstâncias adequadas para conferir uma alma.[1] As circunstâncias em questão são discutidas no restante deste artigo. Ao tentar construir tais máquinas, não estaríamos usurpando irreverentemente Seu poder de criar almas, assim como não o fazemos na procriação de filhos; em vez disso, somos, em ambos os casos, instrumentos de Sua vontade, fornecendo moradas para as almas que Ele cria.

No entanto, isso é mera especulação. Não me impressiono muito com argumentos teológicos, independentemente do que eles visam fundamentar. No passado, tais argumentos muitas vezes se mostraram insatisfatórios. Na época de Galileu, argumentava-se que os textos “O sol parou no meio do céu e por quase um dia inteiro não se pôs” (Josué 10:13) e “Firmaste a terra sobre os seus fundamentos para que jamais se abale” (Salmos 104:5) eram uma refutação adequada da teoria copernicana.[2] Com o conhecimento atual, tal argumento parece fútil. Quando esse conhecimento não estava disponível, ele causava uma impressão bem diferente.

(2) A objeção da “cabeça enfiada na areia”. “As consequências de máquinas pensantes seriam terríveis demais. Esperemos e acreditemos que elas não sejam capazes disso”.

Esse argumento raramente é expresso tão abertamente quanto na forma acima. Mas afeta a maioria de nós que refletimos sobre o assunto. Gostamos de acreditar que o ser humano é, de alguma forma sutil, superior ao resto da criação. Melhor seria poder demonstrar que ele é necessariamente superior, pois então não haveria perigo de ele perder sua posição de comando. A popularidade do argumento teológico está claramente ligada a esse sentimento. É provável que ele seja bastante forte entre os intelectuais, já que eles valorizam o poder de pensar mais do que outros, e se inclinam mais a basear sua crença na superioridade do Ser Humano quanto a esse poder.

Não creio que esse argumento seja suficientemente substancial para exigir uma refutação. Uma consolação seria mais apropriada: talvez ela deva ser buscada na transmigração das almas.

(3) A objeção matemática. Há uma série de resultados da lógica matemática que podem ser usados para mostrar limitações nos poderes das máquinas de estados discretos. O mais conhecido desses resultados é o teorema de Gödel (1931), que demonstra, que em qualquer sistema lógico suficientemente poderoso, podem ser formuladas afirmações que não podem ser provadas nem refutadas dentro do sistema, a menos que, possivelmente, o próprio sistema seja inconsistente. Existem outros resultados, em alguns aspectos semelhantes, devidos a Church (1936), Kleene (1935), Rosser[3] e Turing (1937). Este último é o mais conveniente de se considerar, pois se refere diretamente a máquinas, enquanto os outros só podem ser usados em um argumento comparativamente indireto: por exemplo, se o teorema de Gödel for usado, precisamos, além disso, de algum meio para descrever sistemas lógicos em termos de máquinas, e máquinas, em termos de sistemas lógicos. O resultado em questão se refere a um tipo de máquina que é essencialmente um computador digital com capacidade infinita. Ele afirma que existem certas coisas que tal máquina não pode fazer. Se ela for programada para dar respostas a perguntas como no jogo da imitação, haverá algumas perguntas para as quais ela dará uma resposta errada ou não dará resposta alguma, independentemente do tempo concedido para a resposta. Pode haver, é claro, muitas dessas perguntas, e perguntas que não podem ser respondidas por uma máquina poderiam ser respondidas satisfatoriamente por outra. É claro que estamos supondo, por ora, que as perguntas são do tipo para as quais uma resposta “sim” ou “não” é apropriada, em vez de perguntas como “O que você acha de Picasso?”. As perguntas em que sabemos que as máquinas devem falhar são deste tipo: “Considere a máquina especificada da seguinte forma… Ela responderá sempre “sim” a qualquer pergunta?” As reticências devem ser substituídas pela descrição de alguma máquina em um formato padrão, que poderia ser algo como o usado na seção 5. Quando a máquina descrita tiver uma certa relação comparativamente simples com a máquina que está sendo interrogada, pode-se demonstrar que a resposta está errada ou não é possível. Este é o resultado matemático: argumenta-se que ele prova uma incapacidade das máquinas à qual o intelecto humano não está sujeito.

A resposta curta a esse argumento é que, embora esteja estabelecido que existem limitações aos poderes de qualquer máquina em particular, foi apenas afirmado, sem qualquer tipo de prova, que tais limitações não se aplicam ao intelecto humano. Mas não creio que essa visão possa ser descartada tão levianamente. Sempre que uma dessas máquinas é questionada sobre o ponto crucial apropriado e fornece uma resposta definitiva, sabemos que essa resposta deve estar errada, e isso nos dá uma certa sensação de superioridade. Essa sensação é ilusória? Sem dúvida, é genuína, mas não creio que devamos atribuir-lhe demasiada importância. Nós mesmos damos respostas erradas com muita frequência, o que torna injustificável nossa satisfação diante dessa evidência de falibilidade por parte das máquinas. Além disso, nossa superioridade só pode ser sentida em tal ocasião em relação à única máquina sobre a qual conquistamos nosso pequeno triunfo. Não haveria possibilidade de triunfar simultaneamente sobre todas as máquinas. Em suma, então, pode haver humanos mais inteligentes do que qualquer máquina específica, mas também pode haver outras máquinas ainda mais inteligentes, e assim por diante.

Aqueles que defendem o argumento matemático, creio eu, estariam dispostos a aceitar o jogo da imitação como base para discussão. Aqueles que acreditam nas duas objeções anteriores provavelmente não estariam interessados em quaisquer critérios.

(4) O argumento da consciência. Este argumento está muito bem expresso pelo Professor Geoffrey Jefferson no Discurso Lister de 1949,[4] do qual cito um trecho: “Somente quando uma máquina puder escrever um soneto ou compor um concerto devido a pensamentos e emoções sentidas, e não devido à ocorrência casual de símbolos, é que poderemos concordar que máquina é igual a cérebro — isto é, não apenas escrevê-lo, mas saber que o escreveu. Nenhum mecanismo poderia sentir (e não apenas sinalizar artificialmente, um artifício fácil) prazer pelos seus êxitos, tristeza, quando suas válvulas se queimam, deleitar-se diante da bajulação, sentir-se infeliz por seus erros, encantar-se com o sexo, ficar com raiva ou deprimida quando não consegue o que quer”.

Esse argumento parece ser uma negação da validade do nosso teste. De acordo com a forma mais extrema dessa concepção, a única maneira de se ter certeza de que uma máquina pensa é ser a máquina e se sentir pensando. Poderíamos então descrever esses sentimentos ao mundo, mas é claro que ninguém teria justificativa para prestar atenção. Da mesma forma, de acordo com essa concepção, a única maneira de saber que um homem pensa é ser esse homem em particular. Na verdade, esse é o ponto de vista solipsista. Talvez seja a concepção mais lógica a se adotar, mas ela dificulta a comunicação de ideias. A tende a acreditar que “A pensa, mas B, não”, enquanto B acredita que “B pensa, mas A, não”. Em vez de argumentar continuamente contra isso, o mais usual é adotar-se a convenção cortês segundo a qual todos pensam.

Tenho certeza de que o Professor Jefferson não deseja adotar o ponto de vista extremo e solipsista. Provavelmente, ele aceitaria, de bom grado, o jogo da imitação como um teste. O jogo (com o jogador B omitido) é frequentemente usado na prática sob o nome de viva voce[5], para descobrir se alguém realmente entende algo ou se “aprendeu como papagaio”. Escutemos um trecho de um viva voce:

Interrogador: No primeiro verso do seu soneto, que diz “Devo comparar-te a um dia de verão?”[6], não seria tão bom ou melhor dizer “um dia de primavera”?

Testemunha: Não teria a métrica correta.

Interrogador: Que tal “um dia de inverno”? Isso sim a teria.

Testemunha: Sim, mas ninguém quer ser comparado a um dia de inverno.

Interrogador: Diria que o Sr. Pickwick[7] lhe fez lembrar o Natal?

Testemunha: De certa forma.

Interrogador: Mas o Natal é um dia de inverno, e não creio que o Sr. Pickwick se importaria com a comparação.

Testemunha: Não acho que esteja falando sério. Por “dia de inverno”, entende-se um típico dia de inverno, e não um dia especial, como o Natal.

E assim por diante. O que diria o Professor Jefferson se a máquina de escrever sonetos fosse capaz de responder dessa forma no viva voce? Não sei se ele consideraria a máquina como se respondesse mandando “meros sinais artificiais”. Mas, se as respostas fossem tão satisfatórias e consistentes quanto no trecho acima, não creio que ele a descreveria como “um dispositivo simples”. Essa expressão, creio, pretende abranger dispositivos como uma máquina que inclui uma gravação de alguém lendo um soneto, com interruptores apropriados para ligá-la de vez em quando.

Em suma, creio que a maioria daqueles que apoiam o argumento da consciência poderia ser persuadida a abandoná-lo em vez de ser forçada à posição solipsista. Provavelmente, eles estariam dispostos a aceitar nosso teste.

Não quero dar a impressão de que acho que não há mistério algum sobre a consciência. Há, por exemplo, algo paradoxal relacionado a qualquer tentativa de localizá-la. Mas não acho que esses mistérios precisem necessariamente ser resolvidos antes que possamos responder à pergunta que nos interessa neste artigo.

(5) Argumentos de incapacidades diversas. Esses argumentos assumem esta forma: “Admito que você pode fazer máquinas realizarem todas as coisas que mencionou, mas nunca conseguirá fazer uma sequer realizar X”. Inúmeras características X são sugeridas nesse contexto. Apresento uma seleção: ser gentil, engenhosa, bonita, amigável, ter iniciativa, ter senso de humor, saber distinguir o certo do errado, cometer erros, apaixonar-se, gostar de morangos com creme, fazer alguém se apaixonar por ela, aprender com a experiência, usar as palavras corretamente, ser autora de seus próprios pensamentos, ter tanta diversidade de comportamento quanto um ser humano, fazer algo realmente novo.

Geralmente, não há embasamento para essas afirmações. Acredito que se baseiam principalmente no princípio da indução científica. Um homem já viu milhares de máquinas ao longo da vida. A partir do que observa, extrai uma série de conclusões gerais. Elas são feias; cada uma é projetada para um propósito muito limitado; quando necessárias para um propósito ligeiramente diferente, são inúteis; a variedade de comportamento de qualquer uma delas é muito pequena; e assim sucessivamente. Naturalmente, ele conclui que essas são propriedades necessárias das máquinas em geral. Muitas dessas limitações estão associadas à capacidade de armazenamento muito pequena da maioria das máquinas. (Estou supondo que a ideia de capacidade de armazenamento inclui, de alguma forma, máquinas que não são de estados discretos. A definição exata não importa, pois não se exige precisão matemática na presente discussão. Há alguns anos, quando se ouvia falar muito pouco de computadores digitais, se alguém mencionasse suas propriedades sem descrever sua construção, suscitaria muita incredulidade a respeito deles. Isso provavelmente se devia a uma aplicação semelhante do princípio da indução científica. É claro que essas aplicações do princípio são, em grande parte, inconscientes. Quando uma criança que tenha se queimado teme o fogo e demonstra esse medo evitando-o, eu diria que ela está aplicando a indução científica. (Eu poderia, é claro, descrever seu comportamento de muitas outras maneiras.) As obras e os costumes da humanidade não parecem ser um material muito adequado para a aplicação da indução científica. Uma grande parte do espaço-tempo deve ser investigada para que se obtenham resultados confiáveis. Caso contrário, podemos (como faz a maioria das crianças inglesas) decidir que todo mundo fale inglês e que é bobagem aprender francês.

No entanto, é preciso fazer observações especiais a respeito de muitas das incapacidades mencionadas. A incapacidade de gostar de morangos com creme pode ter parecido algo frívolo ao leitor. Talvez uma máquina pudesse ser programada para apreciar esse delicioso prato, mas qualquer tentativa nesse sentido seria idiota. O importante dessa incapacidade é que ela contribui para algumas das outras incapacidades; por exemplo, para a dificuldade de ocorrer, entre homem e máquina, o mesmo tipo de amizade que ocorre entre um homem branco e outro homem branco, ou entre um homem negro e outro homem negro.

A crítica de que “máquinas não são capazes de cometer erros” parece curiosa. A tentação é de retrucar: “Elas são piores por isso?” Mas adotemos uma atitude interpretativa mais empática, tentando entender o que realmente se quer afirmar. Acho que essa crítica pode ser explicada em termos do jogo da imitação. Alega-se que o interrogador poderia distinguir a máquina do homem simplesmente lhes apresentando uma série de problemas de aritmética. A máquina seria desmascarada devido à sua mortal precisão. A resposta para isso é simples. A máquina (programada para jogar o jogo) não tentaria dar as respostas certas para os problemas de aritmética. Deliberadamente, ela cometeria erros de forma calculada para confundir o interrogador. Uma falha mecânica provavelmente se manifestaria por meio de uma decisão inadequada quanto ao tipo de erro a ser cometido nos cálculos aritméticos. Mesmo essa interpretação da crítica não é suficientemente favorável. Mas não temos espaço para aprofundar muito mais o assunto. Parece-me que essa crítica se baseia em uma confusão entre dois tipos de erro, que podemos chamar de “erros de funcionamento” e “erros de conclusão”. Erros de funcionamento se devem a alguma falha mecânica ou elétrica que faz com que a máquina se comporte de maneira diferente daquela para a qual foi projetada. Em discussões filosóficas, tende-se a ignorar a possibilidade de tais erros; portanto, as discussões dizem respeito a “máquinas abstratas”. Essas máquinas são ficções matemáticas, e não objetos físicos. Por definição, são incapazes de erros de funcionamento. Nesse sentido, podemos afirmar que “máquinas nunca cometem erros”. Erros de conclusão só podem surgir quando algum significado é atribuído aos sinais de saída da máquina. A máquina poderia, por exemplo, digitar equações matemáticas ou frases em inglês. Quando uma proposição falsa é digitada, dizemos que a máquina cometeu um erro de conclusão. Claramente, não há razão alguma para dizer que uma máquina não pode cometer esse tipo de erro. Ela poderia simplesmente digitar repetidamente “0 = 1”. Para considerar um exemplo menos perverso, ela poderia ter algum método para obter conclusões por indução científica. É preciso esperar que tal método leve ocasionalmente a resultados errôneos.

A afirmação de que uma máquina não pode ser o sujeito de seu próprio pensamento só pode ser respondida, é claro, se pudermos mostrar que a máquina tem algum pensamento com algum assunto. No entanto, “o assunto das operações de uma máquina” parece significar algo, ao menos para as pessoas que lidam com ela. Se, por exemplo, a máquina estivesse tentando encontrar uma solução para a equação x2 - 40x - 11 = 0, seria tentador descrever essa equação como parte do assunto da máquina naquele momento. Nesse sentido, uma máquina sem dúvida pode ser seu próprio assunto. Ela pode ser usada para ajudar a criar seus próprios programas ou para prever o efeito de alterações em sua própria estrutura. Observando os resultados de seu próprio comportamento, ela pode modificar seus próprios programas para atingir algum objetivo com mais eficácia. Essas são possibilidades de um futuro próximo, e não sonhos utópicos.

A crítica de que uma máquina não pode ter um comportamento muito diversificado é apenas uma maneira de dizer que ela não pode ter muita capacidade de armazenamento. Até recentemente, uma capacidade de armazenamento de mil dígitos era muito rara.

As críticas que estamos considerando aqui são frequentemente formas disfarçadas do argumento da consciência. Normalmente, se alguém afirmar que uma máquina pode fazer uma dessas coisas e descrever o tipo de método que a máquina poderia usar, não causará muita impressão. Acredita-se que o método seja realmente bastante básico (seja ele qual for, pois deve ser mecânico). Compare isso com a afirmação entre parênteses na declaração de Jefferson citada acima.

(6) A objeção de Lady Lovelace[8]. Nossa informação mais detalhada sobre a Máquina Analítica de Babbage vem de um relato de Lady Lovelace (1842)[9], na qual ela afirma: “Não se pretende que a Máquina Analítica possa dar a origem a algo. Ela pode fazer tudo o que soubermos como ordenar que execute” (itálico dela). Essa declaração é citada por Hartree (1949, p. 70), que acrescenta: “Isso não implica que não seja possível construir equipamentos eletrônicos que ‘pensem por si próprios’, ou nos quais, em termos biológicos, se possa estabelecer um reflexo condicionado servindo de base para a ‘aprendizagem’. Se isso, em princípio, é possível ou não, é uma questão estimulante e empolgante, sugerida por alguns desses desenvolvimentos recentes. Mas não parece que as máquinas construídas ou projetadas na época tivessem essa propriedade”.

Concordo plenamente com Hartree nesse ponto. Note-se que ele não afirma que as máquinas em questão não possuíam essa propriedade, mas sim que os indícios disponíveis a Lady Lovelace não a encorajavam a acreditar nisso. É perfeitamente possível que as máquinas em questão tivessem, em certo sentido, adquirido essa propriedade. Pois suponhamos que alguma máquina de estados discretos possua a propriedade. A Máquina Analítica era um computador digital universal, de modo que, se a sua capacidade de armazenamento e velocidade fossem adequadas, ela poderia, por meio de uma programação apropriada, ser projetada para imitar a máquina em questão. Provavelmente esse argumento não ocorreu à Condessa nem a Babbage. De qualquer forma, eles não estavam obrigados a afirmar tudo o que pudesse ser afirmado.

Toda essa questão será considerada novamente sob o título “máquinas que aprendem”.

Uma variante da objeção de Lady Lovelace afirma que uma máquina “nunca pode fazer algo realmente novo”. Isso pode ser defendido, por um momento, com ajuda do ditado: “Não há nada de novo sob o Sol”. Quem pode ter certeza de que o “trabalho original” que alguém fez não resultou simplesmente do crescimento da semente nele plantada pelo ensino, ou por seguir princípios gerais bem conhecidos? Uma variante melhor da objeção diz que uma máquina nunca pode “nos pegar de surpresa”. Esta afirmação representa um desafio mais direto e pode ser respondida diretamente. As máquinas me pegam de surpresa com grande frequência. Isso ocorre principalmente porque não calculo o suficiente para decidir o que esperar que elas façam; ou melhor, porque, embora eu faça um cálculo, faço-o de maneira apressada e descuidada, correndo riscos. Talvez eu diga para mim mesmo: “Estou supondo que a voltagem aqui seja a mesma que lá: em todo o caso, admitamos que seja”. Naturalmente, muitas vezes estou errado, e o resultado é uma surpresa para mim, pois, quando o experimento termina, essas suposições já foram esquecidas. Essas revelações me deixam vulnerável a sermões acerca de meus maus hábitos, mas não lançam dúvidas sobre minha credibilidade quando exponho as surpresas que vivencio.

Não espero que essa resposta silencie meu crítico. Ele provavelmente dirá que as surpresas se devem a algum ato mental criativo da minha parte e não refletem nenhum mérito da máquina. Isso nos leva de volta ao argumento da consciência, e para longe da ideia de surpresa. É uma linha de argumentação que devemos considerar encerrada, mas talvez valha a pena observar que a apreciação de algo como surpreendente exige um significativo “ato mental criativo”, quer o evento surpreendente se origine de um homem, um livro, uma máquina ou qualquer outra coisa.

Acredito que a concepção de que as máquinas não podem gerar surpresas se deve a uma falácia à qual filósofos e matemáticos estão particularmente sujeitos. Trata-se da suposição de que, assim que um fato é apresentado a uma mente, nela surgem, simultaneamente, todas as consequências desse fato. É uma suposição muito útil em muitas circunstâncias, mas esquecemos, com muita facilidade, que ela é falsa. Uma consequência natural dessa suposição é que se assume que não há virtude alguma na mera dedução de consequências a partir de dados e princípios gerais.

(7) Argumento da continuidade no sistema nervoso. O sistema nervoso certamente não é uma máquina de estados discretos. Um pequeno erro na informação sobre a magnitude de um impulso nervoso que incide sobre um neurônio pode fazer uma grande diferença na magnitude do impulso de saída. Pode-se argumentar que, sendo assim, não se pode esperar imitar o comportamento do sistema nervoso com um sistema de estados discretos.

É verdade que uma máquina de estados discretos deve ser diferente de uma máquina contínua. Mas se respeitarmos as condições do jogo da imitação, o interrogador não poderá tirar proveito dessa diferença. A situação pode ficar mais clara se considerarmos outra máquina contínua mais simples. Um analisador diferencial se sairá muito bem. (Um analisador diferencial é um certo tipo de máquina, mas não de estados discretos; ele é usado para alguns tipos de cálculo.) Algumas dessas máquinas fornecem suas respostas em formato impresso e, portanto, são adequadas para participar do jogo. Para um computador digital, não seria possível prever exatamente quais respostas o analisador diferencial daria a um problema, mas ele seria perfeitamente capaz de fornecer o tipo certo de resposta. Por exemplo, se solicitado a fornecer o valor de π (na verdade, cerca de 3,1416), seria razoável que escolhesse aleatoriamente entre os valores 3,12, 3,13, 3,14, 3,15, 3,16, com as probabilidades de 0,05, 0,15, 0,55, 0,19, 0,06 (digamos). Nessas circunstâncias, seria muito difícil para o interrogador distinguir o analisador diferencial do computador digital.

(8) O argumento da informalidade do comportamento. Não é possível produzir um conjunto de regras que pretenda descrever o que alguém deve fazer em todas as circunstâncias concebíveis. Pode-se, por exemplo, ter uma regra que diga que se deve parar ao ver um semáforo vermelho, e seguir ao ver um verde, mas e se, por algum acaso, ambos aparecerem ao mesmo tempo? Pode-se decidir que é mais seguro parar. Mas mais tarde alguma dificuldade adicional pode surgir dessa decisão. Tentar fornecer regras de conduta que cubram todas as eventualidades, mesmo aquelas decorrentes de semáforos, parece impossível. Concordo com tudo isso.

A partir disso, argumenta-se que não podemos ser máquinas. Tentarei reproduzir o argumento, mas temo não lhe fazer justiça. Ele parece ser algo como: “se cada ser humano tivesse um conjunto definido de regras de conduta pelas quais regulasse sua vida, não estaria em melhor situação do que uma máquina. Mas não existem tais regras, portanto os seres humanos não podem ser máquinas”. A lacuna na distribuição é evidente. Não creio que o argumento seja alguma vez formulado exatamente dessa maneira, mas acredito que este seja o argumento utilizado. Pode haver, contudo, certa confusão entre “regras de conduta” e “leis do comportamento”, que obscurecem a questão. Por “regras de conduta”, refiro-me a preceitos como “Pare, se vir o sinal vermelho”, que podem ser seguidos e dos quais se pode ter consciência. Por “leis do comportamento”, refiro-me às leis da natureza aplicadas ao corpo humano, como “se você o beliscar, ele vai gemer”. Se substituirmos “leis do comportamento que regulam sua vida” por “leis de conduta pelas quais ele regula sua vida” no argumento citado, o meio-termo não distribuído deixa de ser insuperável. Isso porque acreditamos que não só é verdade que ser regido por leis do comportamento implica ser algum tipo de máquina (embora não necessariamente uma máquina de estados discretos), mas também que, inversamente, ser tal máquina implica ser regido por tais leis. Contudo, não podemos nos convencer tão facilmente da ausência de leis completas do comportamento quanto da ausência de regras completas de conduta. A única maneira que conhecemos para encontrar tais leis é a observação científica, e certamente não conhecemos nenhuma circunstância em que pudéssemos dizer: “Já pesquisamos o suficiente. Não existem tais leis”.

Podemos demonstrar com mais força que qualquer afirmação desse tipo seria injustificada. Suponhamos que, se tais leis existirem, podemos ter certeza de que as descobriremos. Então, dada uma máquina de estados discretos, deve certamente ser possível, a partir de um número suficiente de observações, prever seu comportamento futuro, relativamente a um período razoável; digamos, mil anos. Mas esse não parece ser o caso. Configurei o computador de Manchester com um pequeno programa, que usa apenas 1.000 unidades de armazenamento; a máquina, ao receber um número de dezesseis dígitos, responde com outro em dois segundos. Desafio qualquer um a aprender, a partir dessas respostas, o suficiente sobre o programa para ser capaz de prever quaisquer respostas a valores não testados.

(9) O argumento da percepção extrassensorial. Presumo que o leitor esteja familiarizado com a ideia de percepção extrassensorial e o significado de seus quatro itens, a saber, telepatia, clarividência, precognição e psicocinese. Esses fenômenos perturbadores parecem negar todas as nossas ideias científicas usuais. Como gostaríamos de desacreditá-los! Infelizmente, os indícios estatísticos, ao menos para a telepatia, são esmagadores. É muito difícil reorganizar as próprias ideias para acomodar esses novos fatos. Uma vez que os aceitamos, não parece um grande passo acreditar em fantasmas e bichos-papões. A ideia de que nossos corpos se movem simplesmente de acordo com as leis conhecidas da física, juntamente com algumas outras ainda não descobertas, mas de alguma forma semelhantes, seria uma das primeiras a desaparecer.

Esse argumento, a meu ver, é bastante forte. Pode-se responder que muitas teorias científicas parecem continuar viáveis na prática, apesar de entrarem em conflito com a percepção extrassensorial (PES); que, na verdade, é possível viver muito bem, mesmo as ignorando. Mas esse consolo é bastante frágil e receamos que o pensamento seja justamente o tipo de fenômeno no qual a PES possa ser especialmente relevante.

Um argumento mais específico, baseado na PES, poderia ser o seguinte: “Vamos jogar o jogo da imitação, usando como testemunhas um homem com boa recepção telepática e um computador digital. O interrogador pode fazer perguntas como “A qual naipe pertence a carta na minha mão direita?” O homem, por telepatia ou clarividência, dá a resposta correta 130 vezes em 400 cartas. A máquina só pode adivinhar aleatoriamente e talvez acerte 104 vezes; assim, o interrogador faz a identificação correta”. Aqui se abre uma possibilidade interessante. Suponha que o computador digital contenha um gerador de números aleatórios. Então, será natural usá-lo para decidir qual resposta dar. Mas esse gerador estará sujeito aos poderes psicocinéticos do interrogador. Talvez essa psicocinese possa fazer com que a máquina acerte com maior frequência do que a esperada segundo um cálculo da probabilidade, de modo que o interrogador ainda possa ser incapaz de fazer a identificação correta. Por outro lado, ele pode ser capaz de acertar na identificação sem fazer qualquer pergunta, ao usar a clarividência. Com a percepção extrassensorial, tudo pode acontecer.

Se admitirmos a telepatia, será necessário aprimorar nosso teste. A situação poderia ser considerada análoga à que ocorreria se o interrogador estivesse falando consigo mesmo e um dos competidores estivesse ouvindo com o ouvido na parede. Colocar os competidores em uma “sala à prova de telepatia” satisfaria todas as exigências.

7. Máquinas que aprendem

O leitor já deve ter previsto que não tenho argumentos muito convincentes, de natureza positiva, para sustentar meus pontos de vista. Se eu os tivesse, não teria me dado ao trabalho de apontar as falácias em pontos de vista contrários. Apresentarei agora os indícios que possuo.

Voltemos por um momento à objeção de Lady Lovelace, que afirmava que a máquina só pode fazer o que lhe mandamos fazer. Poderíamos dizer que um homem pode “injetar” uma ideia na máquina, e que ela responderá até certo ponto, entrando depois em repouso, como uma corda de piano percutida por um martelo. Outra analogia seria a de uma “pilha atômica” [atomic pile][10] de tamanho inferior ao crítico: uma ideia injetada corresponderia a um nêutron vindo de fora entrando nessa pilha. Cada nêutron desse tipo causará uma certa perturbação que finalmente se dissipará. Se, no entanto, o tamanho da pilha for suficientemente aumentado, a perturbação causada por um nêutron incidente provavelmente continuará aumentando indefinidamente até que toda a pilha seja destruída. Existe algum fenômeno correspondente no caso das mentes, e das máquinas? Parece, sim, haver um para a mente humana. A maioria das ideias parece ser “subcrítica”, ou seja, correspondendo, nessa analogia, a pilhas de tamanho subcrítico. Em média, uma tal ideia apresentada à mente, dará origem a menos do que uma ideia em resposta. Uma pequena proporção é supercrítica. Uma tal ideia apresentada a uma mente pode dar origem a toda uma “teoria” composta de ideias secundárias, terciárias e mais remotas. As mentes dos animais parecem ser definitivamente subcríticas. Seguindo essa analogia, perguntamos: “é possível construir uma máquina que seja supercrítica?”

A analogia da “casca de uma cebola” também é útil. Ao considerarmos as funções da mente ou do cérebro, encontramos certas operações que podem ser explicadas em termos puramente mecânicos. Dizemos que isso não corresponde à mente real: é uma espécie de casca que devemos remover se quisermos encontrar a mente real. Mas, então, no que resta, encontraremos outra casca a ser removida, e assim por diante. Procedendo dessa maneira, chegaremos à mente “real”, ou, ao final, chegaremos à casca que não tem nada dentro? Neste último caso, a mente inteira é mecânica. (No entanto, como já discutimos, ela não seria uma máquina de estados discretos.)

Não se pretende que esses dois últimos parágrafos sejam argumentos convincentes. Eles deveriam ser descritos como “recitações que tendem a produzir crenças”.

A única sustentação realmente satisfatória que pode ser dada à concepção expressa no início da seção 6 será — esperando até o final do século — realizar o experimento descrito. Mas o que podemos dizer enquanto isso? Quais medidas devem ser tomadas agora para que o experimento seja bem-sucedido?

Como expliquei, o problema é principalmente de programação. Avanços na engenharia também precisarão ser feitos, mas parece improvável que não sejam adequados às necessidades. As estimativas da capacidade de armazenamento do cérebro variam de $10^{10}$ a $10^{15}$ dígitos binários. Inclino-me para os valores mais baixos, e acredito que apenas uma fração muito pequena é usada para os tipos mais complexos de pensamento. A maior parte provavelmente é usada para a retenção de impressões visuais; eu ficaria surpreso se mais de $10^9$ dígitos binários fossem necessários para jogar satisfatoriamente o jogo da imitação, ao menos contra um cego. (Lembrando que a capacidade da Enciclopédia Britânica, 11ª edição, é de 2 x $10^9$) Uma capacidade de armazenamento de 107 seria uma possibilidade bastante viável, mesmo com as técnicas atuais. Provavelmente não seja necessário aumentar a velocidade de operação das máquinas. Nas máquinas modernas, partes que podem ser consideradas análogas às células nervosas funcionam cerca de mil vezes mais rápido do que essas células. Isso deve proporcionar uma “margem de segurança”, que poderia cobrir eventuais perdas de velocidade surgindo de muitas maneiras. Nosso problema então é descobrir como programar essas máquinas para jogar o jogo. No meu ritmo atual de trabalho, produzo cerca de mil dígitos de programação por dia, de modo que cerca de sessenta trabalhadores, trabalhando continuamente ao longo de cinquenta anos, poderiam concluir o trabalho, se nada fosse para o lixo. Algum método mais expedito parece desejável.

No processo de tentar imitar uma mente humana adulta, somos obrigados a pensar bastante sobre o processo que a trouxe ao estado em que se encontra. Podemos observar três componentes.

(a) O estado inicial da mente, digamos, ao nascer;

(b) A educação à qual foi submetida;

(c) Outras experiências, que não devem ser descritas como educação, às quais foi submetida.

Em vez de tentar produzir um programa para simular a mente adulta, por que não tentar produzir um que simule a mente da criança? Se esta fosse então submetida a um curso apropriado de educação, obteríamos o cérebro adulto. Presumivelmente, o cérebro infantil é algo como um caderno comprado em uma papelaria. Mecanismos relativamente simples e muitas folhas em branco. (Do nosso ponto de vista, mecanismo e escrita são quase sinônimos.) Nossa esperança é que haja tão poucos mecanismos no cérebro infantil que algo semelhante a eles possa ser facilmente programado. Podemos supor, em uma primeira aproximação, que a quantidade de trabalho na educação seja muito semelhante à de uma criança humana.

Dividimos, portanto, nosso problema em duas partes: a criança-programa e o processo educacional. As duas permanecem intimamente ligadas. Não podemos esperar encontrar uma boa criança-máquina na primeira tentativa. É preciso experimentar ensinar uma tal máquina e ver o quão bem ela aprende. Pode-se então tentar outra e ver se é melhor ou pior. Há uma conexão óbvia entre esse processo e a evolução, pelas identificações:

Estrutura da criança-máquina = Material hereditário

Mudanças na criança-máquina = Mutações

Seleção natural = Julgamento do experimentador

No entanto, podemos esperar que esse processo seja mais expedito do que a evolução. A sobrevivência do mais apto é um método lento para medir vantagens. O experimentador, pelo exercício da inteligência, deve ser capaz de acelerá-lo. Igualmente importante é o fato de que ele não está restrito a mutações aleatórias. Se ele puder rastrear a causa de alguma fraqueza, provavelmente poderá pensar no tipo de mutação que a melhorará.

Não será possível aplicar à máquina exatamente o mesmo processo de ensino aplicado a uma criança normal. Ela não será, por exemplo, provida de pernas, de modo que não se possa lhe pedir para sair e encher o balde de carvão. Possivelmente, ela não teria olhos. Mas, por mais que essas deficiências pudessem ser superadas por uma engenharia inteligente, não se poderia mandar a criatura para a escola sem que as outras crianças zombassem excessivamente dela. Ela precisa receber alguma instrução. Não temos que nos preocupar muito com as pernas, os olhos etc. O exemplo da Srta. Helen Keller[11] mostra que a educação pode ocorrer, contanto que a comunicação entre professor e aluno, em ambas as direções, possa acontecer por algum meio.

Normalmente, associamos punições e recompensas ao processo de ensino. Algumas máquinas-crianças simples podem ser construídas ou programadas com base nesse tipo de princípio. A máquina precisa ser construída de forma que os eventos que precederam a ocorrência de um sinal de punição tenham pouca probabilidade de se repetirem, enquanto um sinal de recompensa aumenta a probabilidade de repetição dos eventos que o antecederam. Essas definições não pressupõem quaisquer sentimentos por parte da máquina. Fiz alguns experimentos com uma dessas máquinas infantis e consegui ensiná-la algumas coisas, mas o método de ensino era muito heterodoxo para que o experimento fosse considerado realmente bem-sucedido.

O uso de punições e recompensas pode, na melhor das hipóteses, fazer parte do processo de ensino. Grosso modo, se o professor não tiver outros meios de comunicação com o aluno, a quantidade de informação que pode lhe alcançar não excede o número total de recompensas e punições que lhe são aplicadas. Ao aprender a repetir “Casabianca”[12], uma criança provavelmente se sentiria muito magoada se o texto só pudesse ser descoberto por meio de uma técnica do tipo “Vinte Perguntas”, em que cada “Não” assumisse a forma de uma pancada.[13] É necessário, portanto, dispor de outros canais de comunicação “não emocionais”. Se estes estiverem disponíveis, é possível ensinar uma máquina, por meio de punições e recompensas, a obedecer a ordens dadas em alguma linguagem, por exemplo, uma linguagem simbólica. Essas ordens devem ser transmitidas pelos canais “não emocionais”. O uso dessa linguagem diminuirá consideravelmente o número de punições e recompensas necessárias.

As opiniões podem variar quanto à complexidade adequada para a criança-máquina. Podemos tentar torná-la o mais simples possível, de forma consistente com os princípios gerais. Alternativamente, poderíamos “embutir” um sistema completo de inferência lógica.[14] Nesse último caso, o armazenamento seria ocupado principalmente por definições e proposições. As proposições teriam vários tipos de status; por exemplo, fatos bem estabelecidos, conjecturas, teoremas matematicamente comprovados, declarações dadas por uma autoridade, expressões com a forma lógica de uma proposição, mas sem valor de crença. Certas proposições podem ser descritas como “imperativos”. A máquina deve ser construída de forma que, assim que um imperativo for classificado como “bem estabelecido”, a ação apropriada ocorra automaticamente. Para ilustrarmos isso, suponhamos que o professor diga à máquina: “Faça sua lição de casa agora”. Isso poderá resultar na inclusão de “O professor disse ‘Faça sua lição de casa agora’” entre os fatos bem estabelecidos. Outro fato desse tipo poderia ser: “Tudo o que o professor diz é verdade”. A combinação desses fatos poderá finalmente resultar na inclusão do imperativo “Faça sua lição de casa agora” entre os fatos bem estabelecidos, e isso, dada a construção da máquina, implicará que a lição de casa de fato começa a ser realizada, mas o efeito é muito satisfatório. Os processos de inferência usados pela máquina não precisam satisfazer aos lógicos mais exigentes. Pode não haver, por exemplo, hierarquia de tipos[15]. Mas isso não significa que necessariamente venham a ocorrer falácias decorrentes da falta de uma hierarquia de tipos [type fallacies], da mesma forma que não estamos fadados a cair em penhascos com bordas não cercadas. Imperativos adequados (expressos nos sistemas, não fazendo parte das regras do sistema), tal como “Não use uma classe, a menos que ele seja uma subclasse de alguma já mencionada pelo professor”, podem ter um efeito semelhante a “Não chegue muito perto da borda”.

Os imperativos que podem ser obedecidos por uma máquina sem membros são necessariamente de caráter intelectual, como no exemplo (fazer a lição de casa) dado acima. Entre esses imperativos, serão importantes aqueles que regulam a ordem em que as regras do sistema lógico em questão devem ser aplicadas. Pois, em cada etapa do uso de um sistema lógico, há muitas etapas alternativas, com cada uma podendo ser aplicada no que diz respeito à obediência às regras desse sistema. Essas escolhas fazem a diferença entre um raciocinador brilhante e um medíocre, não a diferença entre um raciocinador correto e um falacioso. Proposições que levam a imperativos desse tipo podem ser “Quando Sócrates for mencionado, use o silogismo ‘Barbara’[16]” ou “Se um método se provar mais rápido do que outro, não use o método mais lento”. Algumas delas podem ser “dadas por comando”, mas outras podem ser produzidas pela própria máquina, por exemplo, por indução científica.

A ideia de uma máquina que aprende pode parecer paradoxal para alguns leitores. Como as regras de operação da máquina poderiam mudar? Elas devem descrever completamente como a máquina reagirá, seja qual for sua história, quaisquer que sejam as mudanças pelas quais ela possa passar. As regras são, portanto, bastante invariáveis no tempo. Isso é bem verdade. A explicação do paradoxo é que as regras que são alteradas no processo de aprendizagem são de um tipo bem menos pretensioso, reivindicando apenas uma validade efêmera. O leitor pode traçar um paralelo com a Constituição dos Estados Unidos.

Uma característica importante de uma máquina que aprende é que seu professor muitas vezes desconhecerá, em grande parte, o que está acontecendo internamente, embora ainda possa, até certo ponto, prever o comportamento de seu aluno. Isso se aplica com mais força ao aprendizado posterior de uma máquina derivada de uma criança-máquina com um desenho (ou programa) bem testado. Isso contrasta claramente com o procedimento normal ao se usar uma máquina para realizar cálculos, cujo objetivo é ter uma imagem mental clara do estado da máquina a cada instante do cálculo. Esse objetivo só pode ser alcançado com esforço. Diante disso, a ideia de que “a máquina só pode fazer o que sabemos ordená-la a fazer” parece estranha. A maioria dos programas que podemos inserir na máquina resultará em algo que não conseguimos compreender (ou que consideramos completamente aleatório). Presume-se que o comportamento inteligente consista em um afastamento do comportamento totalmente disciplinado envolvido na computação, mas um afastamento leve, que não gere comportamento aleatório ou ciclos repetitivos sem sentido. Outro resultado importante do preparo da nossa máquina, por meio de um processo de ensino e aprendizagem, para participar no jogo da imitação é que a “falibilidade humana” provavelmente será omitida de forma bastante natural, ou seja, sem um “treinamento” especial. (O leitor deve conciliar isso com o ponto de vista apresentado no início da seção 7.) Os processos aprendidos não resultam em 100% de certeza; se assim fosse, não poderiam ser desaprendidos.

Provavelmente seja sensato incluir um elemento aleatório em uma máquina de aprendizado. Um elemento aleatório é bastante útil quando buscamos a solução para algum problema. Vamos supor, por exemplo, que queiramos encontrar um número entre 50 e 200 que seja igual ao quadrado da soma de seus dígitos; poderíamos começar com 51, depois tentar 52 e continuar até encontrarmos um número válido. Alternativamente, poderíamos escolher números aleatoriamente até encontrarmos um bom. Esse método tem a vantagem de não ser necessário registrar os valores testados, mas a desvantagem de que o mesmo valor poderia ser testado duas vezes, o que não é muito importante se houver várias soluções. O método sistemático tem a desvantagem de poder haver um bloco enorme sem soluções na região que precisa ser investigada primeiro. Agora, o processo de aprendizado pode ser visto como uma busca por uma forma de comportamento que satisfaça o professor (ou algum outro critério). Como provavelmente existe um grande número de soluções satisfatórias, o método aleatório parece ser melhor do que o sistemático. Deve-se notar que ele é usado no processo análogo da evolução, onde o método sistemático não é possível. Como seria possível acompanhar as diferentes combinações genéticas que foram testadas, para evitar repeti-las?

Podemos esperar que as máquinas um dia concorram com os seres humanos em todos os campos puramente intelectuais. Mas quais são os melhores para começar? Mesmo essa é uma decisão difícil. Muitas pessoas acham que uma atividade muito abstrata, como jogar xadrez, seria a melhor opção. Também se pode argumentar que o melhor é fornecer à máquina os melhores órgãos sensoriais que o dinheiro possa comprar e, em seguida, ensiná-la a entender e falar inglês. Esse processo poderia seguir o ensino normal de uma criança. As coisas seriam apontadas e nomeadas etc. Novamente, não sei qual é a resposta certa, mas acho que ambas as abordagens devem ser tentadas.

Só conseguimos enxergar um pouco à frente, mas daí podemos ver vemos muito do que precisa ser feito.

REFERÊNCIAS

Butler, Samuel. Erewhon. Londres, 1865 (Capítulos 23, 24, 25, The book of the machines).

Church, Alonzo. “An unsolvable problem of elementary number theory”, American J. of Math., 58 (1936), 345-363.

Gödel, K. “Über formal unentscheidbare Sätze der Principia Mathematica und verwandter Systeme, I”, Monatshefte für Math. und Phys., (1931), 173-189.

Hartree, D. R. Calculating instruments and machines. Nova York, 1949.

Kleene, S. C. “General recursive functions of natural numbers” American J. of Math., 57 (1935), 153-173 e 219-244.

Jefferson, G. “The mind of mechanical man”. Lister Oration for 1949, British Medical Journal, vol. I (1949), 1105-1121.

Lovelace, Condessa de. “Translator’s notes to an article on Babbage’s Analytical Engine”, Scientific Memoirs (R. Taylor, org.), vol. 3 (1842), 691-731.

Russell, Bertrand. History of Western philosophy. Londres, 1940.

Turing, A. M. “On computable numbers, with an application to the Entscheidungsproblem”, Proc. London Math. Soc. (2), 42 (1937), 230-265.

É possível que essa concepção seja herética. São Tomás de Aquino (Summa Theologica, citado por Bertrand Russell, p. 480) afirma que Deus não pode criar um homem sem alma. Mas essa pode não ser uma restrição real aos Seus poderes, mas apenas resultar do fato de que as almas dos homens são imortais e, portanto, indestrutíveis. [Obs.: Esta nota encontra-se ao pé da página 443 do original, mas há indicação, no corpo do texto, de referência a algum trecho específico. Provavelmente se trata de um erro de digitação do original. A referência foi inserida nesta tradução no local que julgamos mais provável. — N.T.] ↩︎

Traduções da versão NVI. [N.T.] ↩︎

A referência a esse autor está faltando no original. Talvez refira-se ao artigo de Barkley Rosser, “Extensions of some theorems of Gödel and Church”, Journal of Symbolic Logic, vol. 1, no. 3 (1936), pp. 87-91. [N.T.] ↩︎

Com o título “A mente do homem mecânico”, o discurso foi proferido na cerimônia de entrega da Medalha Lister, prêmio concedido a Jefferson em 1949. [N. T.] ↩︎

Como é o caso em provas ou exames orais. [N. T.] ↩︎

Primeiro verso do Soneto 18 de Shakespeare. [N. T.] ↩︎

Protagonista do primeiro romance de Charles Dickens, As aventuras do Sr. Pickwick. ↩︎

Augusta Ada Byron King, Condessa de Lovelace. Conhecida atualmente como Ada Lovelace, foi a primeira programadora da história, por ter criado o primeiro algoritmo para ser processado em uma máquina (especificamente, a “máquina analítica”, projetada por Babbage). [N. T.] ↩︎

Incentivada por um amigo cientista, Ada Lovelace traduziu um artigo pioneiro do italiano Luigi Menabrea sobre a Máquina Analítica. O próprio Babbage sugeriu que ela expandisse o artigo com vários apêndices; chamados por Lovelace de “Notas”. A afirmação citada por Turing faz parte do famoso apêndice final, a Nota G. ↩︎

Referência ao empilhamento de blocos de grafite, componente fundamental dos reatores nucleares. O primeiro e mais simples deles, construído em 1942, foi apelidado de “Chicago Pile-1”: seu núcleo era uma pilha — de 6 metros de altura — de blocos de grafite, que separavam centenas de blocos menores de urânio, inseridos em intervalos precisos, e reduziam a velocidade dos nêutrons. [N. T.] ↩︎

Helen Keller (1880-1968) foi uma autora, ativista e conferencista norte-americana, reconhecida mundialmente por ser a primeira pessoa surda e cega a conquistar um bacharelado. Com a ajuda engenhosa da professora Anne Sullivan – que inicialmente não queria que ela tentasse falar –, superou gigantescas barreiras de comunicação, após perder a visão e a audição aos 19 meses de idade, e aprendeu a ler em Braille e a se comunicar usando a voz. Tornou-se um ícone na luta pelos direitos das pessoas com deficiência. ↩︎

Poema de Felicia Hemans, publicado em 1826, que se tornou um clássico nas leituras das escolas primárias do Reino Unido e Estados Unidos, entre as décadas de 1850 e 1950. [N. T.] ↩︎

O julgamento “resposta errada” seria assinalado com algum tipo de golpe aplicado à criança. [N. T.] ↩︎

Ou melhor, o que é “programado” em uma criança-máquina será programado em um computador digital. Mas o sistema lógico não precisará ser aprendido. ↩︎

“Hierarchy of types”, no original. Na Lógica, uma hierarquia de tipos é um sistema estruturado para organizar entidades por níveis de complexidade. Por exemplo, em tal sistema, funções não podem admitir a si mesmas como argumentos (isto é, valores independentes ou de entrada). [N. T.] ↩︎

Nome medieval para o tipo de silogismo aristotélico da “Primeira Figura” (primeiro tipo de estrutura): as três sentenças que o compõem são afirmativas universais, isto é, são da forma “Todo X é Y”. [N. T.] ↩︎

Arquipélago Filosófico, Vol. 2, No. 10 (2026), e-010

ISSN 3086-1136

Informações do Artigo

Artigo: Alan Turing, Máquinas computacionais e inteligência

Autor(es): Arquipélago

Data: 09 Abr 2026

DOI: -

Revista: -

Volume: -

Número: -

Páginas: -

ISSN: -

Citação BibTeX

Leia mais

Correspondência entre Descartes e Elisabeth: a interação entre a mente e o corpo

Breno Franco é doutorando em Filosofia pela Universidade Federal do Rio Grande do Sul e bolsista da CAPES. Está escrevendo uma tese sobre a filosofia de Descartes e traduziu, para a editora Logos, o Discurso do método, a respeito do qual escreveu uma breve apresentação para um número anterior desta

Frank Thomas Sautter, A duração do Inferno, segundo Borges

Frank T. Sautter é professor titular do Departamento de Filosofia da UFSM. Este é o segundo artigo de uma série que está publicando no Arquipélago Filosófico. O primeiro pode ser encontrado aqui. 1 Introdução “A duração do Inferno” (Borges, 2008) é um ensaio de Jorge Luis Borges originalmente publicado em

Bertrand Russell, Conhecimento por ‘experiência direta’ e conhecimento por descrição

Este texto clássico de Russell constitui o capítulo 5 de seu livro de introdução à filosofia, The problems of philosophy (1912) e baseia-se no texto publicado em 1910 nos Proceedings of the Aristotelian Society. Trata-se de um escrito fundamental da epistemologia e da filosofia da linguagem contemporânea, que vem sendo

Ludwik Fleck, Algumas características específicas do pensamento médico

O texto a seguir é uma tradução de uma palestra originalmente proferida em polonês e publicada em 1927 no Archiwum Historji i Filozofji Medycyny. Foi traduzido por Kariel Antonio Giarolo (IFRN) a partir de uma versão em inglês publicada no livro Cognition and fact: materials on Ludwik Fleck, editado por